Es gibt ein paar Dinge, die jeder über Zwillinge weiß. Sie kommen immer paarweise vor, und sie sind nie genau identisch. Wenn es um die industrielle Technologie der digitalen Zwillinge geht, ist es daher nicht verwunderlich, dass es zwei prominente Definitionen mit vielen Ähnlichkeiten, aber auch einigen bedeutenden Unterschieden gibt.

Digitale Zwillinge sind ein wichtiger Bestandteil von cyber-physischen Industriesystemen - der Technologie, die für die laufende vierte industrielle Revolution so wichtig ist wie die Dampfkraft für die erste im 18. und 19. Jahrhundert. Doch obwohl praktisch jeder Anbieter von Hardware oder Software, die zu cyber-physischen Systemen beitragen, behauptet, dass sie mit digitalen Zwillingen kompatibel sind, verwendet jeder seine eigene Definition. Zwei Definitionen, die signifikante Gemeinsamkeiten aufweisen, stammen von dem Technologieforschungs- und Beratungsunternehmen Gartner und dem digitaler Zwilling Consortium, einem Zusammenschluss von Hochschulen, Regierungsstellen und der Industrie, der die Entwicklung, Einführung, Interoperabilität und Sicherheit von digitaler Zwilling enabling technologies beschleunigen will.

Digitale Zwillinge in zwei Definitionen

Laut Gartner haben "alle digitalen Zwillinge zwei Hauptfunktionen zur Verbesserung der Geschäftsergebnisse". Eine dieser Rollen ist die Verbesserung des Situationsbewusstseins: "Funktionell überwachen alle digitalen Zwillinge - zumindest - Daten von Dingen, um unser Situationsbewusstsein zu verbessern." In der Praxis bedeutet dies, dass ein digitaler Zwilling in gewisser Weise den Betrieb eines Prozesses abbildet, indem es Daten verwendet, die von Sensoren gesammelt werden, die die Elemente des Prozesses überwachen - z. B. Maschinen in einer Produktionslinie -, um den Bedienern mitzuteilen, was in ihrem Prozess zu jeder Zeit geschieht, und die analysiert werden können, um Erkenntnisse darüber zu liefern, wie der Prozess optimiert werden könnte, um die Leistung zu steigern und die Umweltleistung zu verbessern. Wenn die digitaler Zwilling mit Aktoren in der Fabrik verbunden ist, kann diese Optimierung sogar automatisch erfolgen. Die Darstellung kann grafisch erfolgen - in Form eines Flussdiagramms des Prozesses oder einer 3D-Darstellung einer Produktionslinie in der Fabrik - oder einfach nur als eine Reihe von sich ändernden Zahlen auf einer Tabelle oder einem Armaturenbrett.

Das digitaler Zwilling Consortium hingegen definiert digitaler Zwilling als "eine virtuelle Darstellung realer Entitäten und Prozesse, synchronisiert mit einer bestimmten Frequenz und Genauigkeit", die "Echtzeit- und historische Daten zur Darstellung der Vergangenheit und Gegenwart und zur Simulation von Zukunftsprognosen" verwendet. Diese Definition besteht nicht auf der von Gartner angegebenen Live-Verbindung zu Sensoren. Für das digitaler Zwilling Konsortium können die Daten stündlich, täglich, wöchentlich oder sogar monatlich aktualisiert werden, solange die Aktualisierungshäufigkeit angegeben ist.

Was beinhaltet eine digitaler Zwilling?

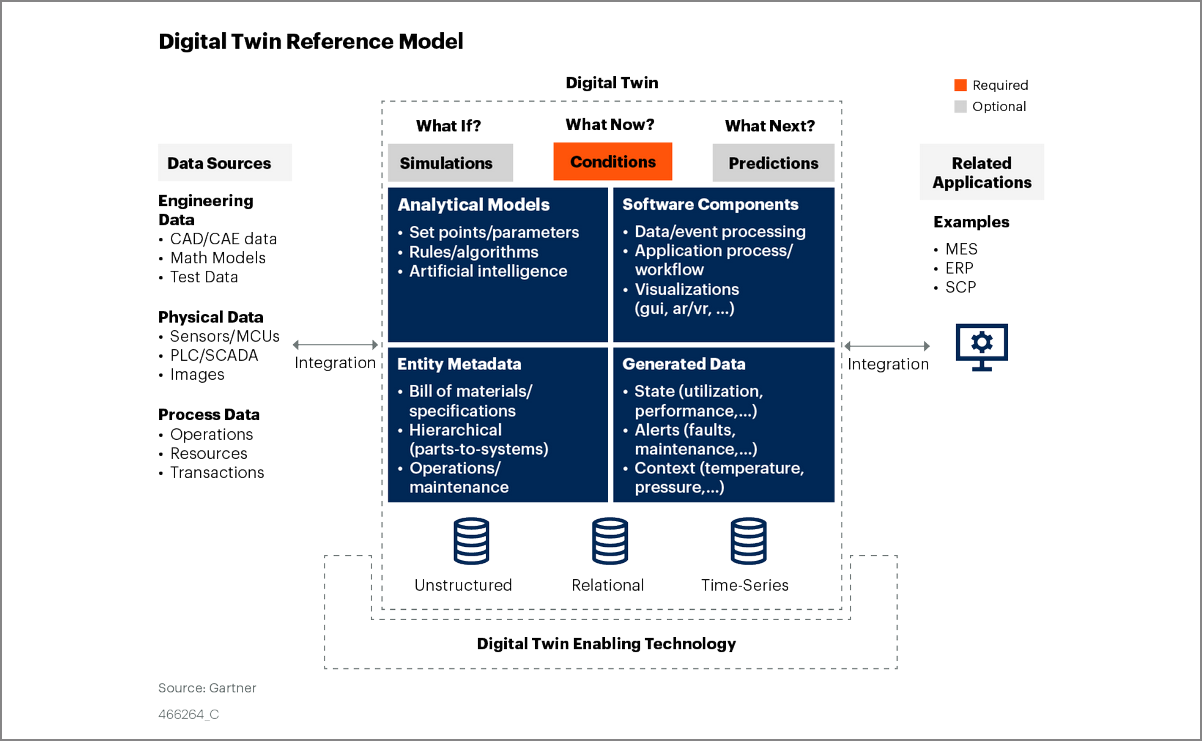

Das Gartner-Modell ruht auf drei "Säulen" und ist aus vier "Blöcken" aufgebaut. Die Säulen sind "Was wäre wenn?" - mit anderen Worten, Simulationen, wie das System auf bestimmte Eingangsbedingungen reagieren würde; "Was ist jetzt?" - Wie verhält sich das System derzeit, abgeleitet aus Live-Daten von verteilten Sensoren; und "Was kommt als nächstes?" - Wie wird sich das System in der Zukunft verhalten, z. B. wann werden die Komponenten wahrscheinlich ausfallen?

Die Blöcke sind die Daten und die Software, die zur Ableitung der Säulen benötigt werden. Zunächst muss das System durch "Entity-Metadaten" definiert werden - dies sind alle Informationen über jede Komponente des Systems, die sich nicht ändern. Dazu können Seriennummern von Maschinen, physikalische Größen und ein detailliertes physikalisches oder grafisches Modell gehören. Die Auswahl der richtigen Menge an Metadaten ist von entscheidender Bedeutung - zu wenig, und die digitaler Zwilling wird die Geräte nicht genau identifizieren; zu viel, und überflüssige Informationen könnten die wesentlichen Fakten überdecken. Sobald das System definiert ist, muss es die "generierten Daten" überwachen und aufzeichnen - alle Informationen über den Zustand der Systemkomponenten, die von dem verteilten Sensornetzwerk der Internet-of-Things-fähigen Geräte gesammelt werden, aus denen die Anlage oder ein anderes System besteht, das in die Partnerschaft einbezogen wird. Auch hier ist es entscheidend, die richtige Granularität zu erreichen.

Sobald Sie all diese Daten haben, müssen Sie etwas damit tun, und hier kommen die beiden anderen Blöcke ins Spiel. Der erste dieser Blöcke sind "analytische Modelle" - definiert als "virtuelle Darstellungen des Verhaltens von Partnerschaften, die das Situationsbewusstsein verbessern". Das Wichtigste an diesen Modellen ist, dass sie die generierten Daten mit dem betrieblichen Zweck der digitaler Zwilling verknüpfen müssen, z. B. die Energiekosten, die entstehen, wenn eine Werkzeugmaschine mit einer bestimmten Geschwindigkeit betrieben wird, oder die Auswirkungen einer Prozessänderung auf den Output.

Der letzte Block sind "Softwarekomponenten", die nach Gartners Definition "die Datenaufnahme, die Analyse, die Erzeugung von Ereignissen und - falls erforderlich - die Visualisierung und den Workflow (zur Automatisierung von Geschäftsreaktionen) choreografieren". Beispiele für Softwarekomponenten könnten ein System zur Erstellung und Planung von Wartungsaufgaben als Reaktion auf die von digitaler Zwillinggenerierten Daten oder ein Analysemodell sein, oder ein grafisches Rendering-Paket eines Drittanbieters oder sogar eine Spiele-Engine, um eine Augmented- oder Virtual-Reality-Visualisierung der Anlage zu erstellen.

Nach der Definition des digitaler Zwilling Konsortiums bedeutet der Verweis auf Echtzeit- und historische Daten, die die Vergangenheit und die Gegenwart darstellen und die Zukunft simulieren, dass alle drei Säulen als entscheidend angesehen werden, wobei der Unterschied in der Art und Weise liegt, wie die Daten gesammelt und die digitaler Zwilling aktualisiert werden.

Wie man eine digitaler Zwilling mit räumlichen Daten versorgt

Der Input von Geodatensystemen, wie sie von NavVis zu digitalen Zwillingen kann als Beitrag zu den Blöcken der Entitätsmetadaten und der Softwarekomponenten kategorisiert werden. Dr. Lorenz Lachauer, Head of Solutions bei NavVis, erklärt. "Auf der einen Seite, NavVis liefert Daten, die mit unseren Indoor-Mapping-Systemen erzeugt werden, z.B. die NavVis VLX. Diese Daten, bestehend aus Punktwolken und Panoramabildern, fallen nach der digitaler Zwilling -Definition von Gartner in die Kategorie der externen Datenquellen, genauer gesagt in die Kategorie 'physische Daten'. Darüber hinaus besteht die digitaler Zwilling aus vier wesentlichen Bausteinen, von denen einer eine Softwarekomponente ist. Und darin gibt es Visualisierungskomponenten, und das ist es, wo NavVis IVION hineinpasst."

Lachauer betonte, dass in allen Fällen, NavVis Systeme mit der Fabrik oder Prozessanlage und nicht mit dem Produkt zu tun haben. Es kann Echtzeitdaten mit räumlichen Daten/Visualisierungen der zugehörigen Maschinen verknüpfen und liefert genaue Punktwolkendaten und Panoramabilder und gibt dem Benutzer die Möglichkeit, damit zu interagieren, um einen Standort und physische Form- und Größeninformationen für eine visuelle Darstellung des Fertigungsvorgangs bereitzustellen, denen die generierten Daten dann zugeordnet werden können, um die Navigation im System zu erleichtern und die genauen Stellen zu identifizieren, die zu einem bestimmten Zeitpunkt Aufmerksamkeit erfordern.

"Digitale Zwillinge werden nie von nur einem Hersteller gemacht", kommentiert Lachauer. "Jeder Software- oder Hardware-Hersteller in der Branche behauptet 'wir machen einen digitaler Zwilling'. Aber wir können aus der Gartner-Definition ersehen, dass es sich um etwas handelt, das aus mindestens einigen Komponenten besteht." Es gebe eine wachsende Zahl von IoT-Unternehmen, die Systeme entwickeln und anbieten, die Sensoren, Live-Daten und Konnektivität bereitstellen, aber keine gute Visualisierung der Produktionsanlage bieten, sagt er. "Wenn man also IoT- und Sensordaten einbezieht und sie mit genaueren visuellen Daten kombiniert, erhält man eine umfassende und nützliche digitaler Zwilling."

Phillip Quadstege, Senior Solution Manager, Mitglied des Lachauer-Teams, brachte die Rolle von NavVis auf die Definition des digitaler Zwilling Konsortiums zurück. "Sie besagt, dass es innerhalb der digitaler Zwilling mehrere digitale Modelle gibt, die miteinander korrelieren. Es wird klargestellt, dass digitale Modelle 3D-Messungen, 3D-Modelle CAD , mathematische Gleichungen usw. sein können. Wir passen in diesen Teil der 3D-Messungen. In diesen virtuellen Darstellungen gibt es mehrere Modelle, die miteinander korrelieren und miteinander kommunizieren."

Geodaten werden bei der Digitalisierung von Produktionsanlagen eine Schlüsselrolle spielen

Die meisten physischen Geräte verfügen zunehmend über eine digitaler Zwilling. Laut Lachauer sind jedoch nur sehr wenige Produktionsanlagen oder Vermögenswerte auf diese Weise vollständig dargestellt. Räumliche Daten sind eine Schlüsselkomponente von digitaler Zwilling in der Fertigung, um den generierten Daten einen visuellen Kontext aus der realen Fabrik zu geben. Vor allem, wenn mehrere Teilprozesse über einen Innenraum verteilt sind, mit NavVis Anlagen und Systeme bieten den Bedienern eine einfache Möglichkeit, diese Daten regelmäßig zu erfassen, Änderungen im physischen Layout der Fabrik zu verfolgen und die digitaler Zwilling bei Bedarf zu aktualisieren.

Wie wir weiter oben in diesem Artikel gesehen haben, stimmen die Definitionen von digitalen Zwillingen, die von zwei der einflussreichsten Gremien der Branche vorgelegt wurden, in den meisten Punkten überein. Beide verlangen das Vorhandensein von Daten, die die verschiedenen Komponenten eines Produktionsprozess identifizieren und sich nicht ändern, während der Prozess in Betrieb ist, während sie auch die Sammlung von sich ändernden Daten über den Betrieb dieser Komponenten verlangen. Diese sich ändernden Daten werden analysiert, um Erkenntnisse darüber zu gewinnen, wie der Prozess in der Weise optimiert werden kann, die für seine Betreiber am wichtigsten ist, und sowohl physische als auch Softwarekomponenten tragen zur Zusammensetzung und zum Betrieb der digitaler Zwilling bei.

Ein wesentlicher Unterschied zwischen den beiden Definitionen besteht darin, ob die Betriebsdaten zur sofortigen Aktualisierung des Zwillings verwendet werden oder ob Aktualisierungen in regelmäßigen Abständen geplant sind. NavVis bietet Systeme zur Erfassung und Visualisierung räumlicher Daten, die bei der Definition des physischen Layouts des Raums helfen, in dem die Produktionsprozess untergebracht ist, und kann auch zur Aktualisierung des physischen Modells verwendet werden, das einer digitaler Zwilling zugrunde liegt, wenn Änderungen an diesem Layout vorgenommen werden. Auf diese Weise wird es zu einer der Softwarekomponenten, die zur digitaler Zwilling beitragen.

Fazit

In den folgenden Artikeln erfahren die Leser , wie digitale Zwillinge die Leistung von Produktionsanlagen und -abläufen verbessern können und wie räumliche Daten - wie die, die von NavVis - ein entscheidender Bestandteil davon sein können.

Würden Sie gerne mehr über die NavVis digitale Fabrik Lösung erfahren? Kontaktieren Sie uns für weitere Informationen, oder laden Sie ein Exemplar unseres kostenlosen Leitfadens für den Einstieg in Ihre digitale Fabrik Implementierung herunter.

Quellen

- Gartner Forschung: Verwenden Sie 4 Bausteine für erfolgreiches digitaler Zwilling Design (Autoren: Benoit Lheureux, Yefim Natis, Alfonso Velosa, Marc Halpern. Aktualisiert am 7. Oktober 2021, veröffentlicht am 9. Juni 2020), https://www.gartner.com/en/documents/3986128/use-4-building-blocks-for-successful-digital-twin-design

- digitaler Zwilling Das Konsortium definiert digitaler Zwilling (Autoren: Sean Olcott, Casey Mullen. Veröffentlicht am 12. März 2020), https://blog.digitaltwinconsortium.org/2020/12/digital-twin-consortium-defines-digital-twin.html